| Druckversion: | | Nach dem Drucken: | | und zurück zum Dokument |

Sollte das Drucken mit diesem Schaltknopf nicht funktionieren, nutzen Sie bitte die Druckfunktion in Ihrem Browser: Menü Datei -> Drucken

Konzepte und Definitionen im Modul XII-4 Partielle Regressions- und Korrelationsmodelle

1. Vorbemerkungen

a) Multiple Interdependenzen im Datensatz

-

Die bisher betrachteten zweidimensionalen Regressions- und Korrelationsmodelle analysieren in der Regel einen Ausschnitt des Beziehungsgeflechtes zwischen vielen Variablen.

-

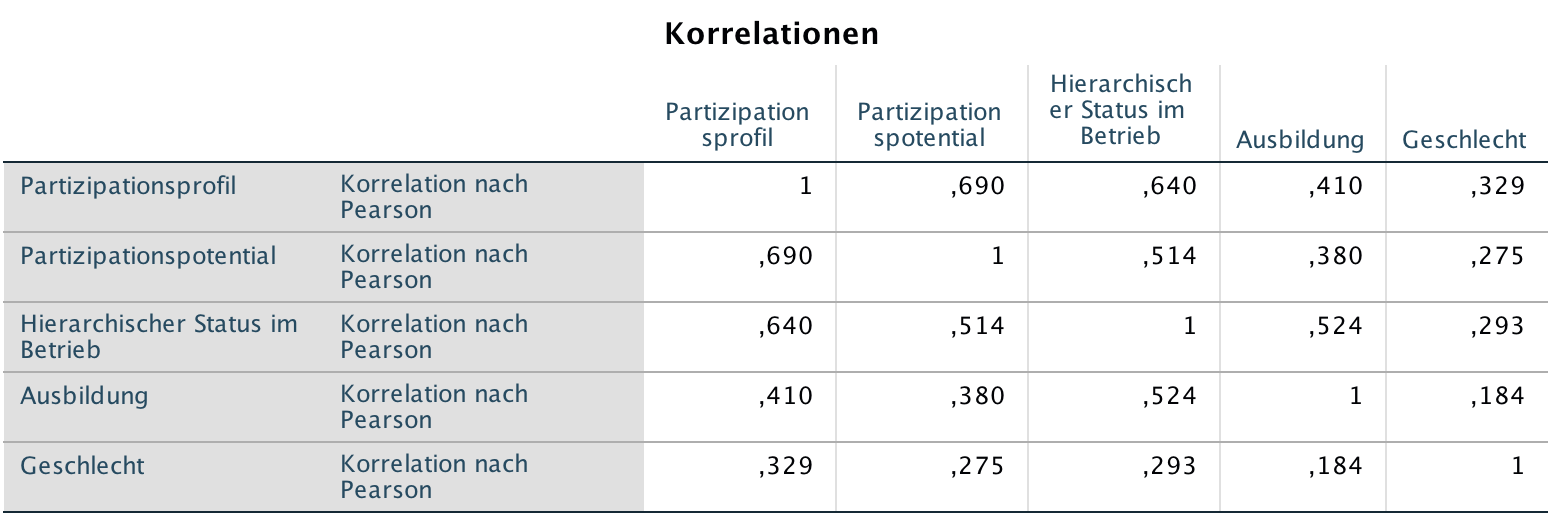

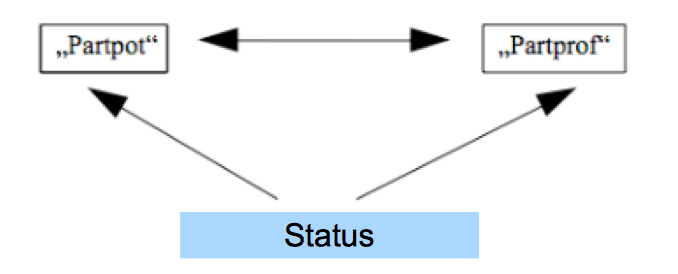

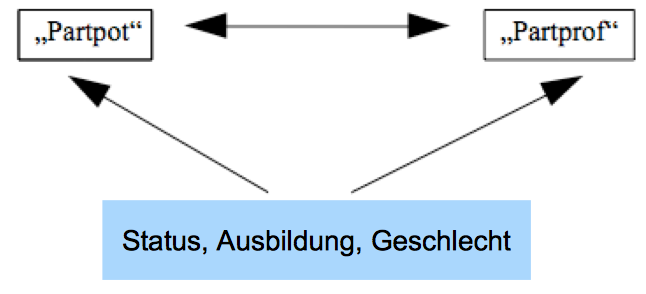

Betrachten wir dazu wieder die Beteiligungen an betrieblichen Entscheidungsprozessen, so spielen dabei nicht nur die tatsächliche und die gewünschte Beteiligung eine Rolle, sondern auch der hierarchische Status, das Ausbildungsniveau und möglicherweise auch das Geschlecht der beteiligten Personen eine Rolle.

-

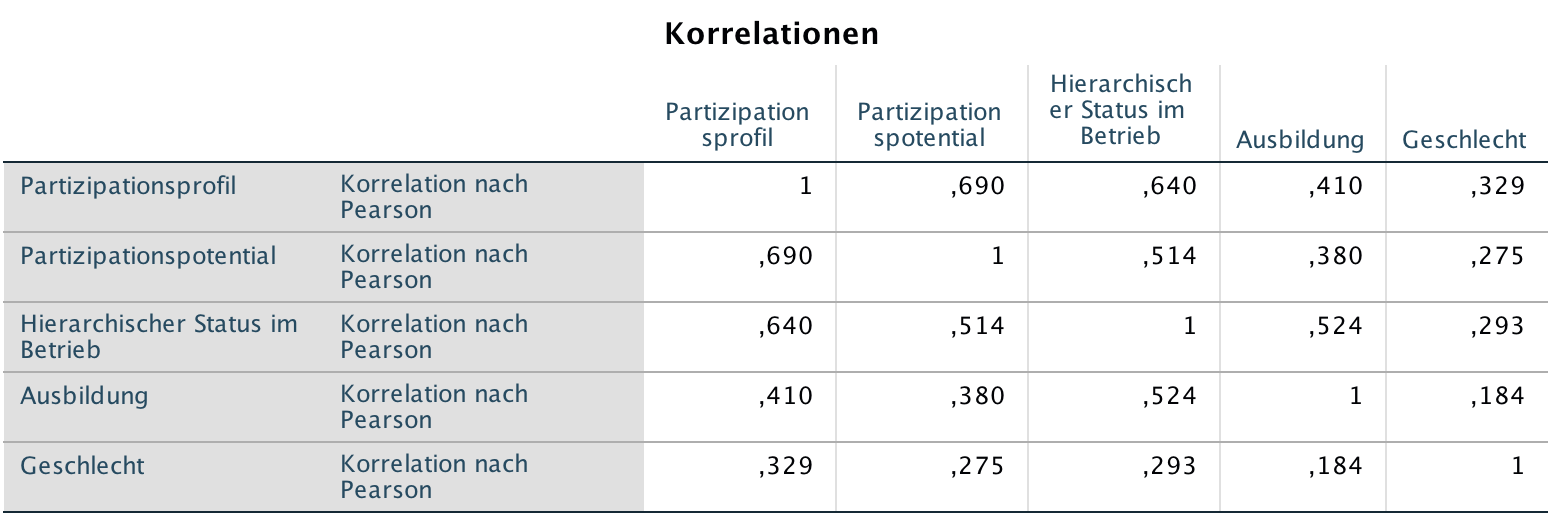

Die Beziehungen zwischen diesen Variablen lassen sich in der nachstehenden Korrelationsmatrix darstellen:

Tabelle 12-1 : Die Korrelationsmatrix der entscheidungsrelevanten Variablen

-

Die Korrelationsmatrix belegt mehr oder minder starke Korrelationen zwischen allen Variablen. Zwar ist mit r = 0,69 die Korrelation zwischen der tatsächlichen Beteiligung (partprof) und der gewünschten Beteiligung (partpot) am grössten, doch auch die Zusammenhänge zwischen partprof und dem Status (r = 0,64), der Ausbildung (r = 0,41) und auch dem Geschlecht (r = 0,329) sind gewichtig.

b) Multiple Interdependenzen in Regressions- und Korrelationsmodellen

-

In der Regressionsfunktion x1 = a + b · x2 + e

werden die Wirkungen der Variablen

x2.... xk zwar nicht völlig ausgeblendet, aber der Fehlervariablen e subsumiert und damit im Einzelnen nicht mehr erfassbar.

-

Die Wirkungen weiterer Variablen lassen sich nun auf zwei verschiedene Weisen modellieren:

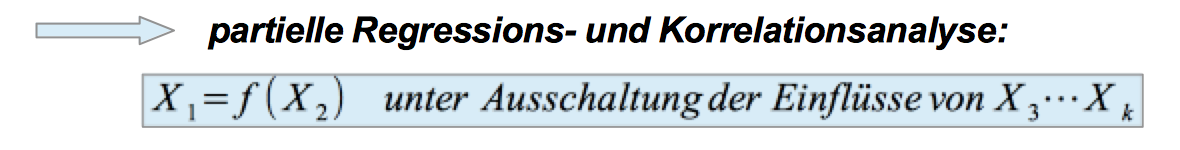

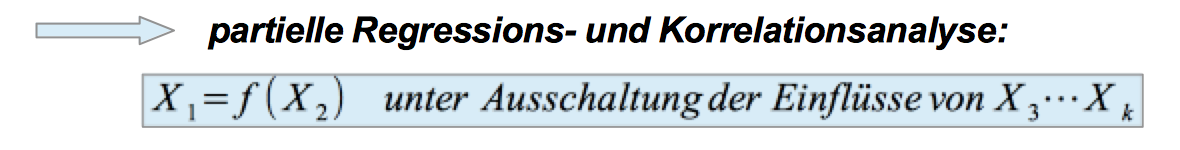

Das partielle Regressions- und Korrelationsmodell :

Mit diesem Ansatz kann der Frage nachgegangen werden, ob ein bestimmter Zusammenhang durch weitere Variablen beeinträchtigt wird. Z.B. also, ob der Zusammenhang zwischen der gewünschten Beteiligung und der tatsächlichen Beteiligung durch den Status der Person mit determiniert oder gestört wird und wie stark er (noch) wäre, wenn dieser Einfluss ausgeschaltet würde. Daraus resultiert die:

Dieses Modell wird in diesem Kapitel vorgestellt

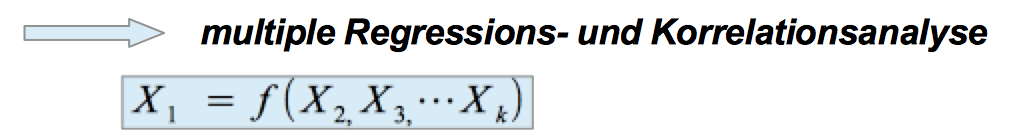

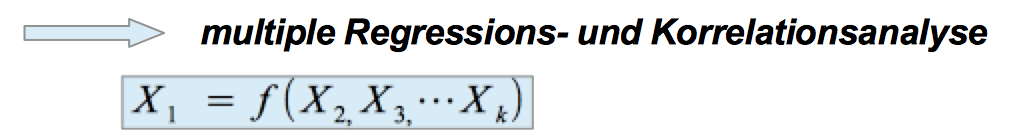

Das multiple Regressions- und Korrelationsmodell :

Im multiplen Regressions- und Korrelationsmodell lassen sich Erklärungs-Zusammenhänge durch weitere Variablen verdichten. Indem untersucht wird, ob die tatsächliche Beteiligung nicht nur durch den Status der Person, sondern auch durch deren Ausbildungsniveau, deren Geschlecht und letztlich auch durch deren Interesse an einer Beteiligung determiniert wird und dadurch insgesamt besser erklärt werden kann. Daraus ergibt sich die:

Die Behandlung diese Modells erfolgt dann im nächsten Kapitel XII-6.

2. Das partielle Regressions- und Korrelationsmodell

a) Die Beeinträchtigung der Beziehung x1 = f(x2) durch weitere Variablen

Bei der Analyse einer Regressionsbeziehung soll das Resultat möglichst unbeeinflusst von weiteren Variablen ermittelt werden. Dabei sind drei verschiedene Typen von Einflüssen bedeutsam:

-

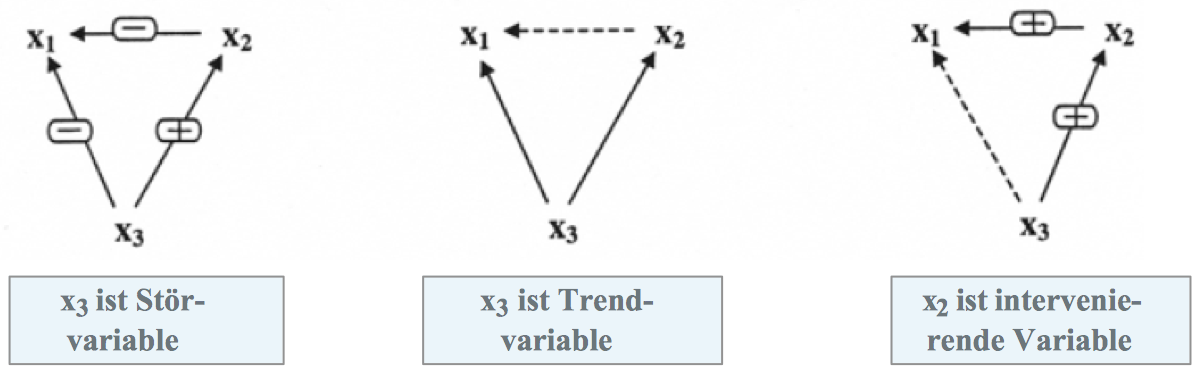

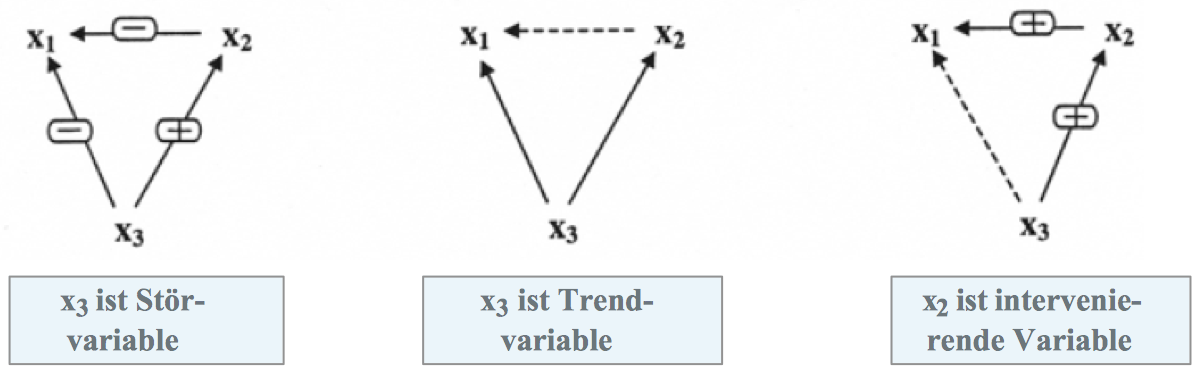

Die Störvariable:

Ein Einfluss von Störvariablen liegt dann vor, wenn eine Variable x3 entweder mit beiden Variablen gleichsinnig oder mit der einen Variablen positiv und mit der anderen Variablen negativ korreliert ist. Erst wenn diese Variable ausgeschaltet (konstant gehalten) wird, kann der eigentliche Zusammenhang zwischen x1 und x2 exakt ermittelt werden.

-

Die Trendvariable:

Dies ist der Fall einer regionalen Korrelation von Storchennestern und Säuglingsgeburten, deren Anzahl aufgrund einer regionalen Industrialisierung gleichzeitig zurückgehen. Zwischen den Variablen besteht also nur eine Scheinkorrelation. Wenn die Trendvariable ausgeschaltet wird, ist keine Korrelation von mehr festzustellen.

Die intervenierende Variable:

In diesem Fall sind die Wirkungen der Variablen funktional miteinander verknüpft. Wenn x3 unverändert beleibt, ist auch keine Wirkung von x2 zu verzeichnen.

-

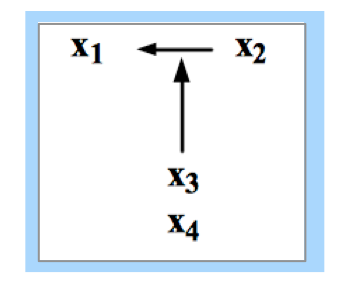

Abbildung 12-10: Mögliche Wirkungen einer Variablen x3

b) Das Konzept der partiellen Regression und Korrelation

Die Definition der Partialvariablen:

Eine Partialvariable ist eine Variable xj, aus der der Einfluss einer (oder mehrerer) Variablen ausgeschaltet wurde.

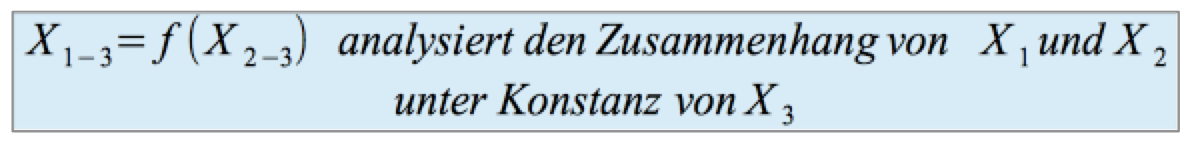

Die Definition des partiellen Regressions-und Korrelationsmodells:

Die partielle Regression und Korrelation ist eine einfache Regression und Korrelation von Partialvariablen. Es gelten dafür die bekannten Formeln für a und b und den Korrelationskoeffizienten analog für die Partialvariablen.

c) Die Varianten des partiellen Regressions- und Korrelationsmodells

3. Das einfache partielle Regressions-und Korrelationsmodell

a) Die Beziehung zwischen den Partialvariablen x1-3 und x2-3

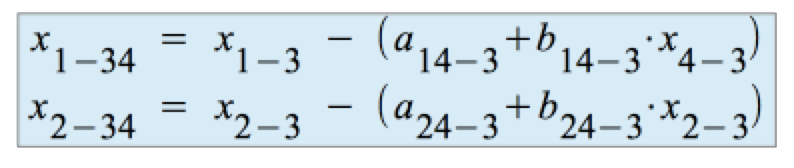

Die Definition der Partialvariablen x1-3 und x2-3:

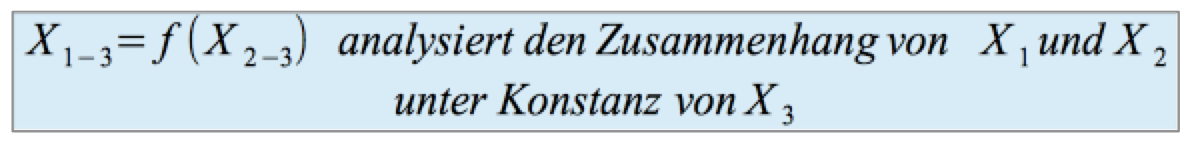

Die Partialvariablen x1-3 und x2-3 sind der Teil der Ausgangsvariablen, der sich ergibt wenn der Einfluss von x3 ausgeschaltet wurde. Damit wird der Zusammenhang x1 = f(x2) unter der Bedingung analysiert, dass x3 konstant gehalten wird:

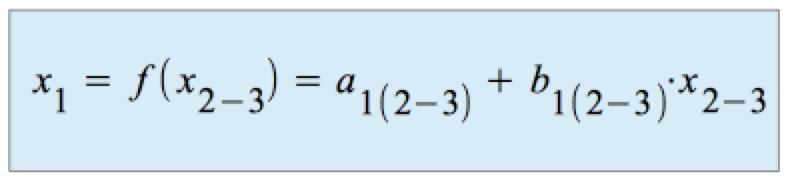

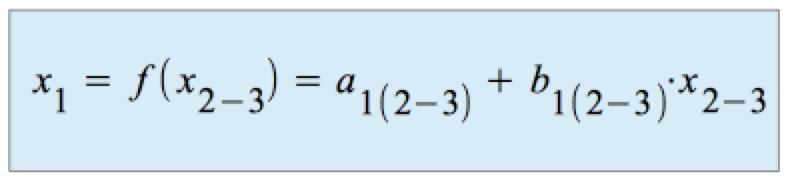

Das einfache partielle Regressionsmodell:

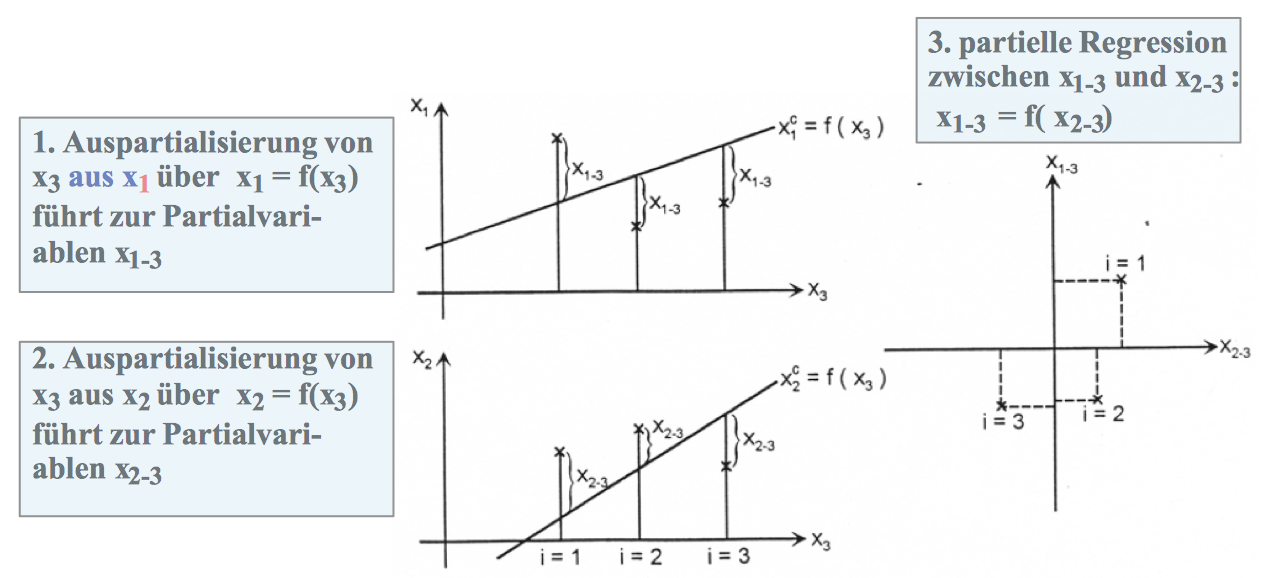

b) Die Auspartialisierung des Einflusses von x3

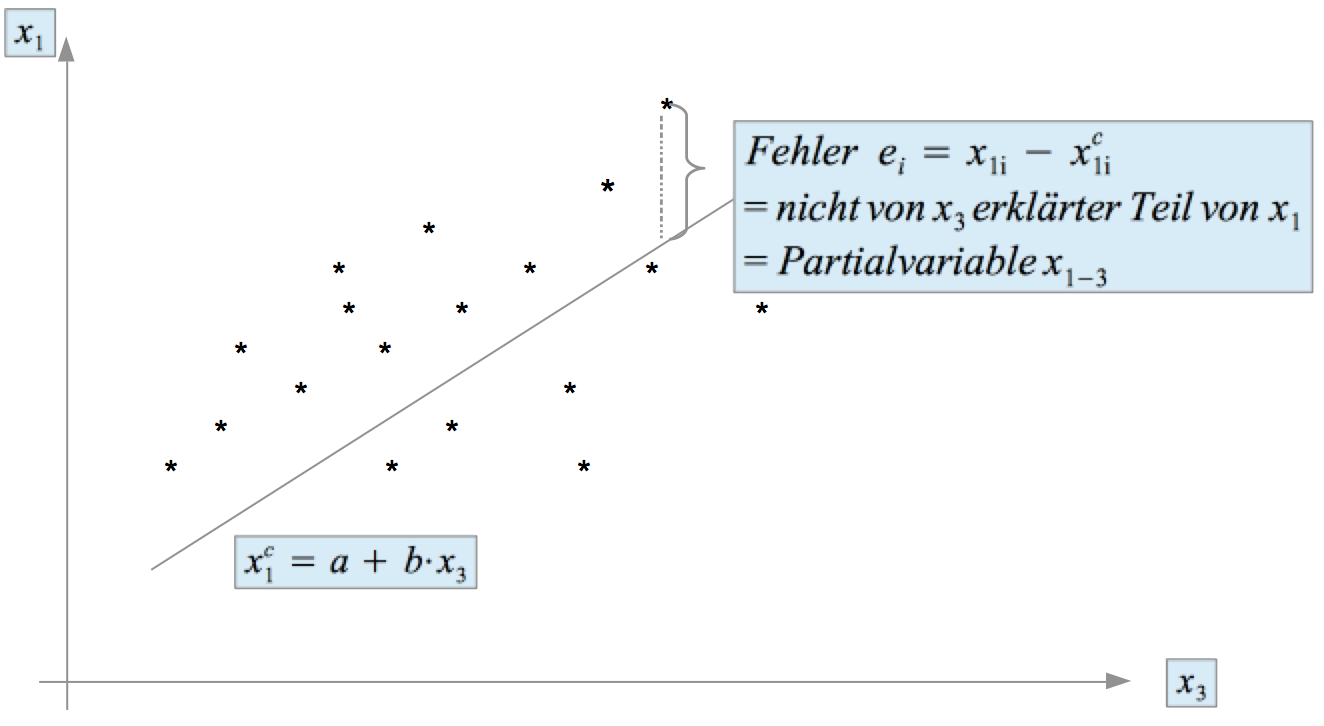

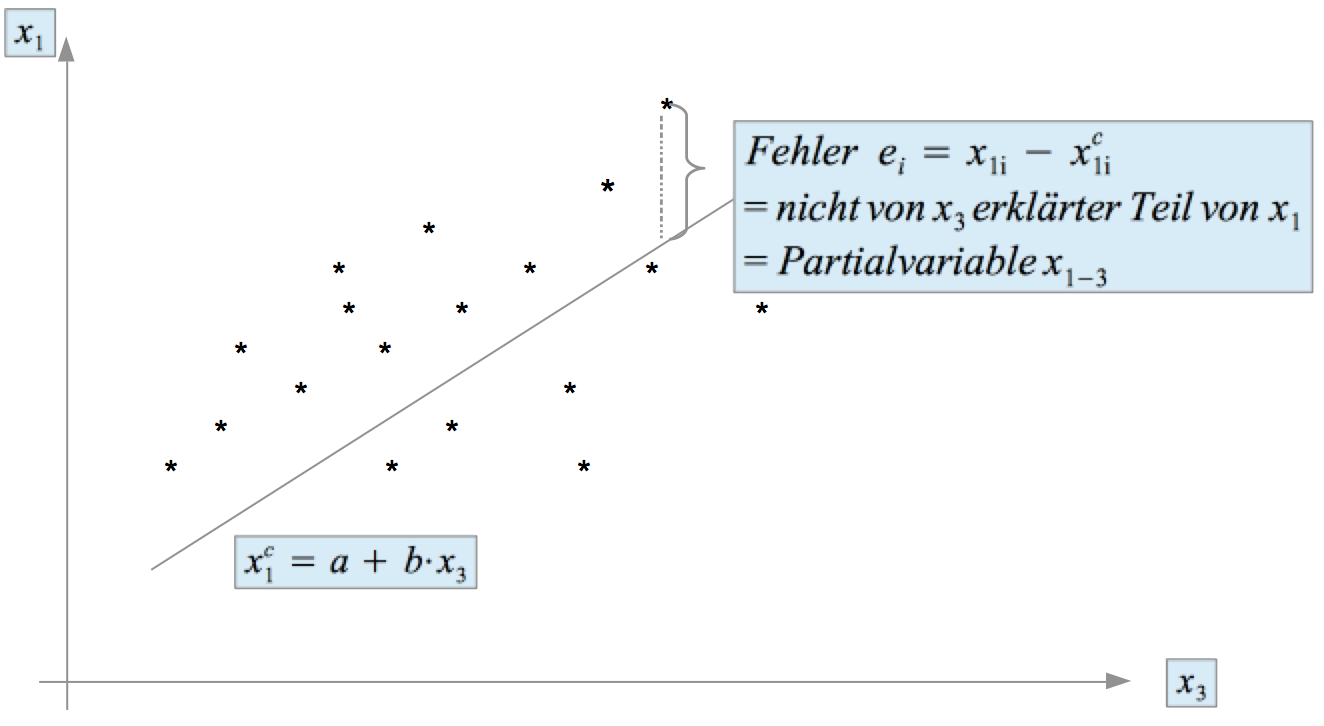

Ausgangspunkt: Die Fehlervariable:

Abbildung 12-14: Die Fehlervariable ei als Partialvariable

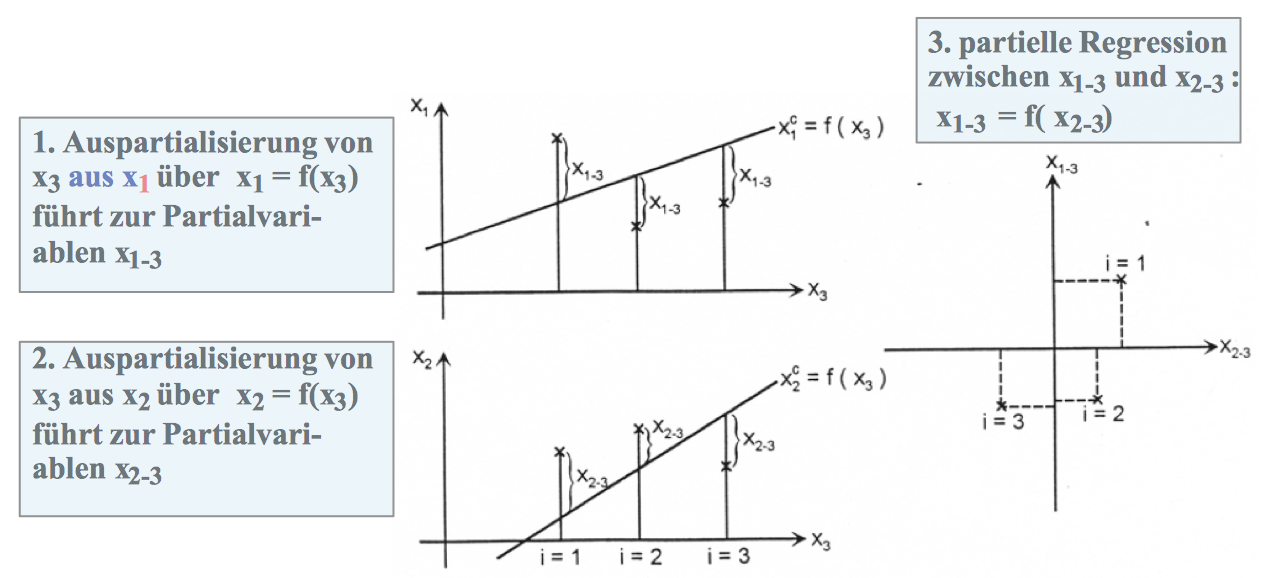

Die Konstruktion der Partialvariablen:

Abbildung 12-15: Drei Schritte zur Partialfunktion

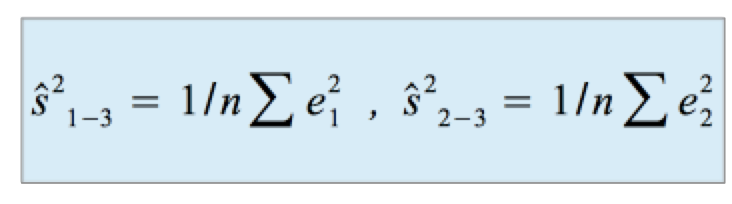

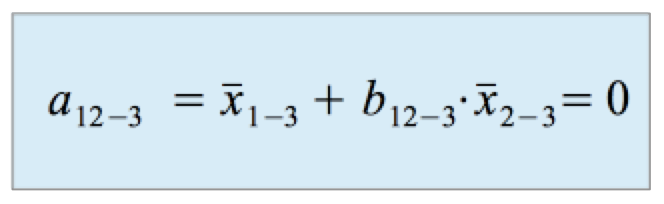

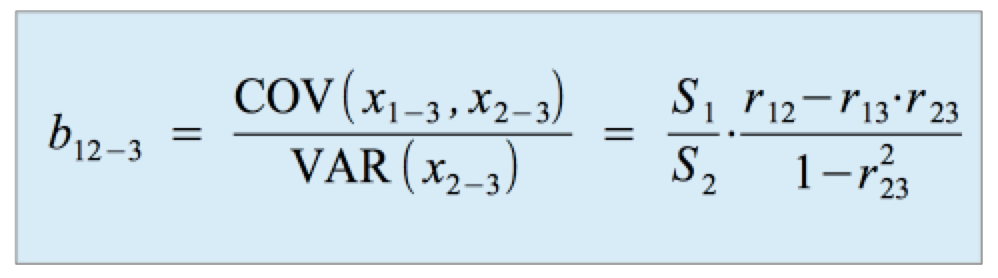

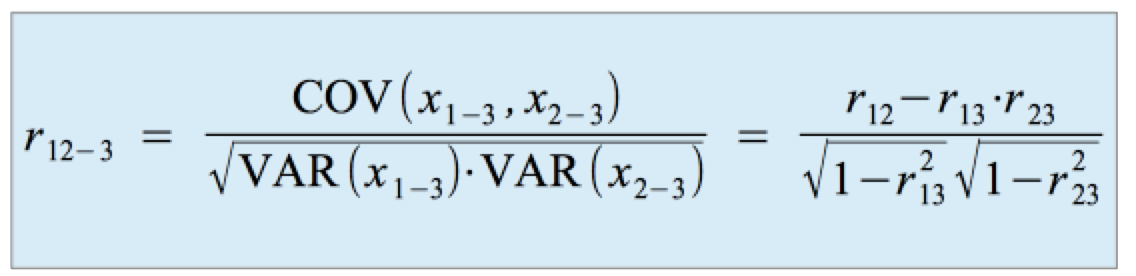

c) Die Komponenten des einfachen partiellen Regressions- und Korrelationsmodells

4. Die mehrfache partielle Regressions- und Korrelation

a) Die Ausgangskonstellation

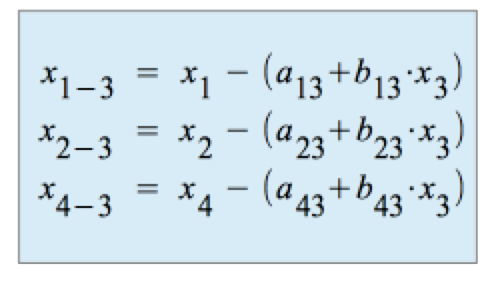

b) Die Partialvariablen

Die beiden auszupartialisierenden Variablen x3 und x4 werden nacheinander ausgeschlossen. D.h. im ersten Schritt wird die Variable aus den Variablen eliminiert. Damit erhalten wir zuerst die Partialvariablen 2. Ordnung und danach die 3. Ordnung:

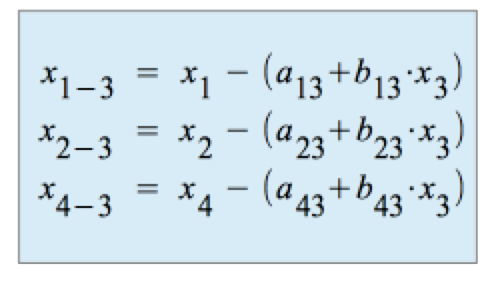

Die Partialvariablen 2. Ordnung:

Wichtig dabei ist, dass der Einfluss der Variablen x3 nicht nur aus x1 und aus x2 sondern auch aus x4 eliminiert werden muss.

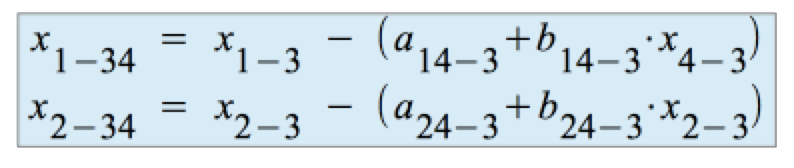

Die Partialvariablen 3. Ordnung::

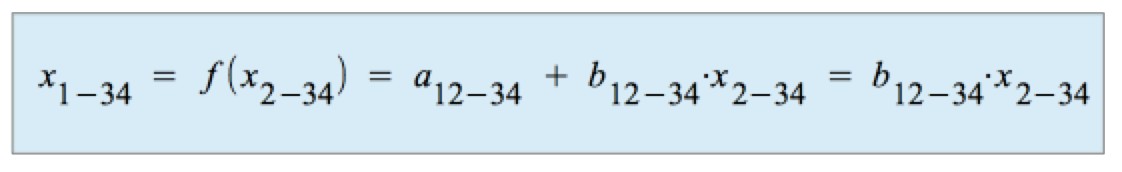

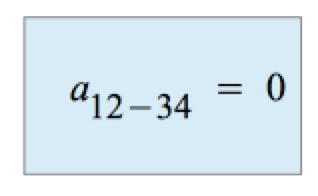

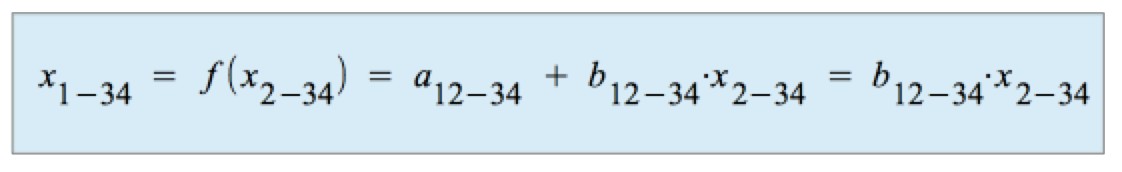

c) Die Regressionsfunktion

-

Die Funktionsform:

-

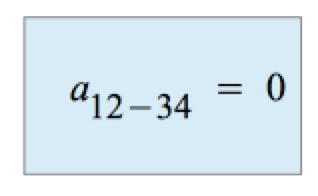

Die dreifache partielle Regressionskonstante :

-

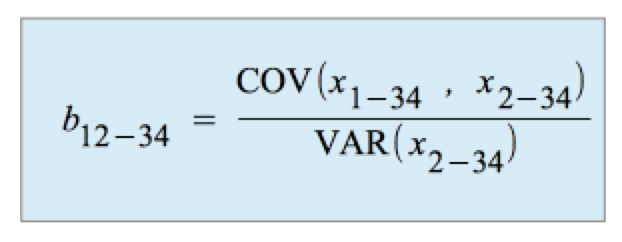

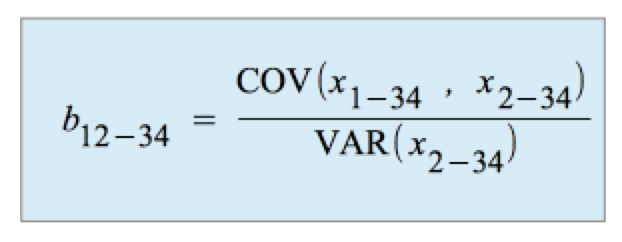

Der dreifache partielle Regressionskoeffizient :

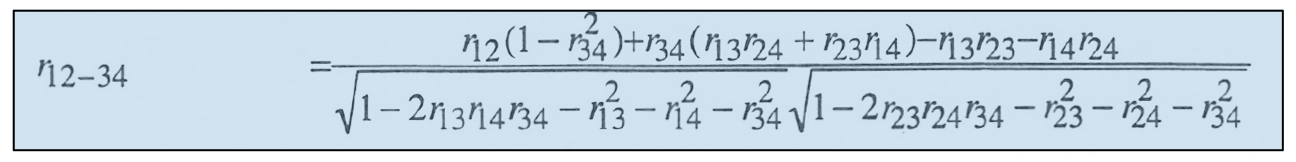

Anmerkung: Analog zum einfachen partiellen Regressionskoeffizienten gehen in den mehrfachen partiellen Regressionskoeffizienten ebenfalls alle einfachen Korrelationskoeffizienten des Modells (r12 .....r34) in die entwickelte Formel ein (zur Formel und zur Ableitung vgl. Litz: Multivariate Statistische Methoden, München 2000)

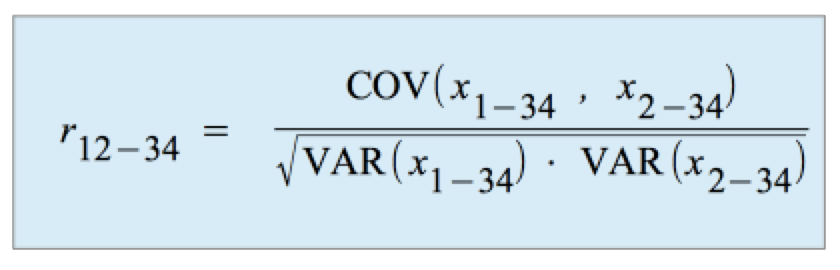

d) Der Korrelationskoeffizient

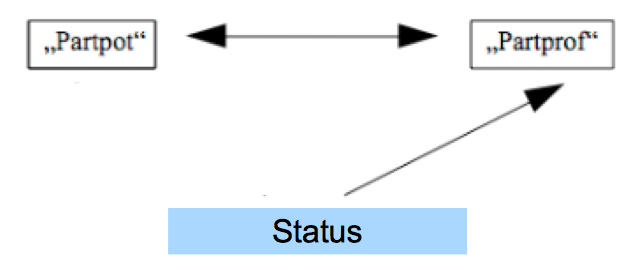

5. Die semi-partielle Regressions- und Korrelation

a) Die Ausgangskonstellation

Bei der semipartiellen Korrelation wird die Störvariable nur aus der

unabhängigen Variablen auspartialisiert. Dies soll hier am Beispiel der einfachen semi-partiellen Regression und Korrelation demonstriert werden.

Betrachtet wird die Funktion x1 = f( x2-3) mit der

Partialvariable 1. Ordnung x2-3.

b) Die Komponenten des Modells

Die Regressionsfunktion:

mit der Funktionsform:

-

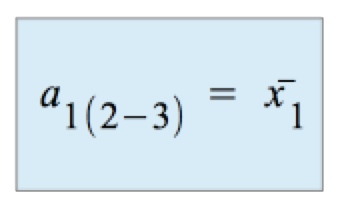

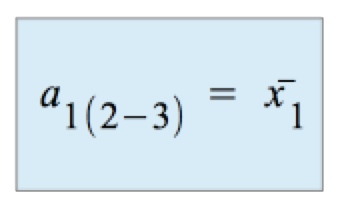

Die einfache semi-partielle Regressionskonstante :

Damit entspricht die einfache semi-partielle Regressionskonstante dem arithmetischen Mittel der abhängigen Variablen.

-

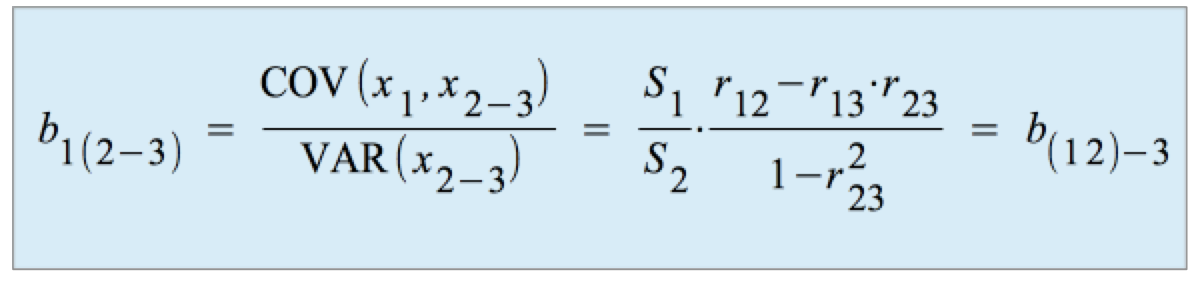

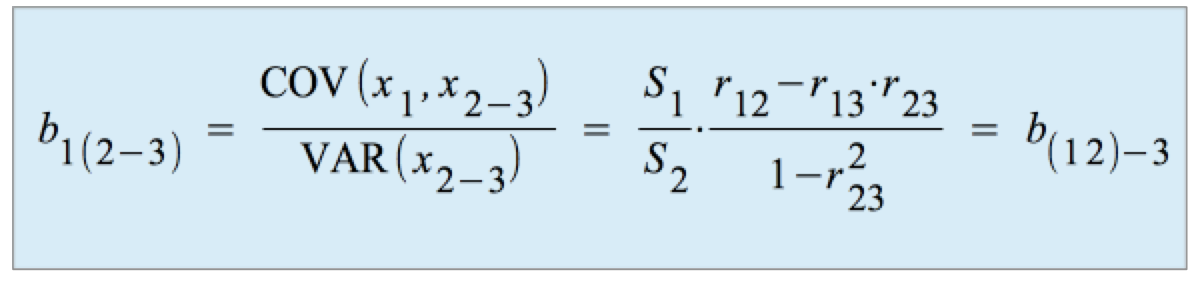

Der einfache semi-partielle Regressionskoeffizient :

Damit entspricht der einfache semi-partielle Regressionskoeffizient dem einfachen partiellen Regressionskoeffizienten

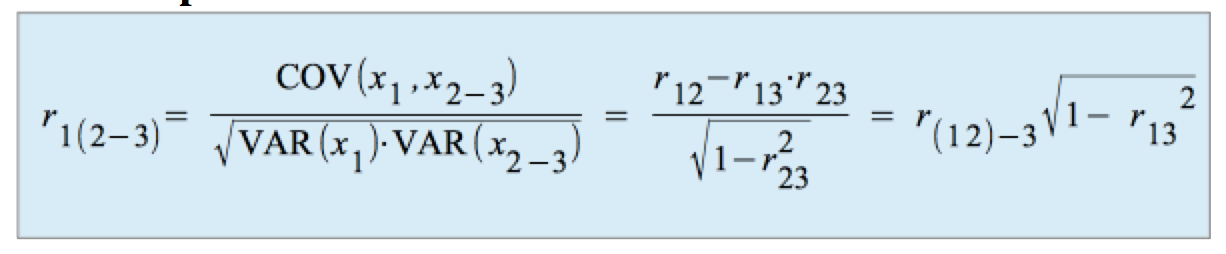

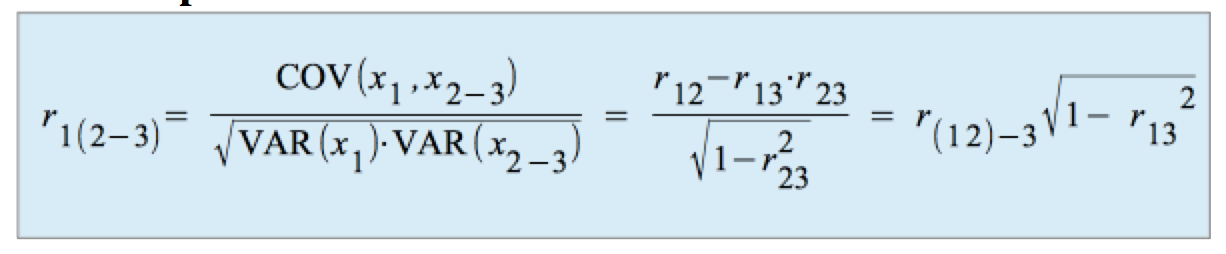

c) Der einfache semi-partielle Korrelationskoeffizient

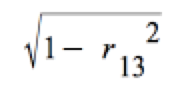

Damit ist der einfache semi-partielle Korrelationskoeffizient um den Betrag

kleiner als der einfache partielle Korrelationskoeffizient.

kleiner als der einfache partielle Korrelationskoeffizient.

letzte Änderung am 28.2.2020 um 7:49 Uhr.

Adresse dieser Seite (evtl. in mehrere Zeilen zerteilt)

http://viles.uni-oldenburg.de/navtest/viles1/kapitel12_Erweiterungen~~ldes~~llinearen~~lRegressionsmodells/modul04_Partielle~~lRegressions-~~lund~~lKorrelations

modelle/ebene01_Konzepte~~lund~~lDefinitionen/12__04__01__01.php3

und

und

kleiner als der einfache partielle Korrelationskoeffizient.

kleiner als der einfache partielle Korrelationskoeffizient.